Avaliação de Imóveis Urbanos

Auxiliar de Corretor de Imóveis

1 Normas Técnicas:

A ABNT - Associação Brasileira de Normas Técnicas é o Fórum Nacional de Normalização. As Normas Brasileiras, cujos conteúdos são de responsabilidade dos Comitês Brasileiros (ABNT/CB) e dos Organismos de Normalização Setorial (ABNT/ONS) e das Comissões de Estudos Especiais Temporários (ABNT/CEET), são elaboradas por Comissões de Estudo (CE), formadas por representantes dos setores envolvidos, delas fazendo parte: produtores, consumidores e neutros (universidades, laboratórios e outros) (ABNT NBR 14653-2).

Em meados de 1950 surgiram as primeiras normas de avaliação de imóveis organizadas por entidades públicas e institutos. Devido à ocorrência de grande quantidade de desapropriações em São Paulo, ocasionado pela expansão da cidade e construção do metrô na década de 1960, as normas ganharam maior relevância. Porém, o primeiro anteprojeto de normas da ABNT na Engenharia de Avaliação data de 1957. Em 1977, estudos feitos por comissões de profissionais dedicados às perícias e avaliações judiciais, em essência, deram origem à primeira Norma Brasileira para Avaliação de Imóveis Urbanos, a NB-502/77 da ABNT (Dantas).

Depois de passar por uma revisão em 1989, a Norma Brasileira para Avaliação de Imóveis Urbanos foi registrada no INMETRO como NBR 5676. Os níveis de precisão foram transformados em níveis de rigor. Segue-se a ela a Norma para Avaliação de Servidões. Alguns institutos, com base na NBR 5676, produziram, paralelamente, normas específicas de forma mais detalhada observando as características de cada região. Atualmente existe uma proposta levada à ABNT para sintetizar o tema de Engenharia de Avaliações em uma norma única.

Trata-se da Norma para Avaliação de Bens, formada por uma parte principal, contendo os conceitos, métodos e definições comuns a todos os bens e, nos apêndices, a parte específica para cada tipologia de bem a avaliar.

2 Avaliação de Imóveis Urbanos:

Avaliação:

A Norma NB-502/89 (NBR-5676) da ABNT, de avaliação de imóveis urbanos, define avaliação como a determinação técnica do valor de um imóvel ou de um direito sobre o imóvel. A avaliação de imóveis é a definição técnica do valor de mercado dos bens ou de direitos sobre eles. Esta definição é feita dentro de procedimentos técnicos para a realização das análises de valor. Segundo Moreira, avaliar é a arte de estimar valores apropriados e específicos, em que o conhecimento técnico e o bom-senso são condições fundamentais. Abunahman define avaliação como sendo uma aferição de vários fatores econômicos definidos em relação a propriedades descritas com data prevista, tendo como base a análise de dados relevantes.

Valor:

Desde sua origem, o homem busca estabelecer preços para os bens, tais que satisfaçam sua noção de valor numa transação e de maneira que se efetivem trocas, sejam elas diretas como o escambo ou indiretas como a moeda. O conceito de valor de um bem, de modo geral, é intuitivo e subjetivo, quer seja vendedor ou comprador deste bem, podendo variar entre os participantes de um mercado.

No entanto, o preço é uma característica que representa a quantidade de dinheiro paga pelo bem. Segundo Bráulio, muitas medidas de valor podem estar relacionadas a um bem, dentre elas o custo de produção, ao qual são agregados outros custos como matéria-prima, estocagem e comercialização desde o produtor até o produto final onde será formado o preço e o valor de mercado, não havendo necessariamente uma relação matemática entre eles.

No entanto, em mercados que se aproximam daquele de concorrência perfeita, os preços são estabelecidos pela lei da oferta e procura independentemente dos custos de produção. Em vista disso, no mercado considerado, o valor do bem poderá não apresentar nenhuma relação com os custos citados (podendo mesmo ser inferior). Quando o mercado permanece estável por um longo período, o preço e a quantidade acabam sendo negociados através da oferta e procura.

Toda a subjetividade e intuição que leva os participantes do mercado a tentar suprir sua satisfação, tornam-se, portanto em quantidades vendidas e ofertadas e seus respectivos preços. Logo, o preço estabelecido pelo mercado é considerado uma representação justa do valor do bem analisado.

Nos mercados onde são efetuadas trocas indiretas, os preços (valores) são expressos em moeda corrente, podendo ser transformados em outras moedas. As avaliações pelo valor de mercado podem ser consideradas instantâneas, ou seja, são válidas, apenas, por um intervalo curto de tempo. Encontram-se várias definições e interpretações e que são suscetíveis a mudanças sobre os conceitos de valor, valor de mercado e preço. No entanto, torna-se importante determinar alguns critérios para sua aplicação prática.

Assim, um trabalho de avaliação imobiliária constitui-se de uma série de operações e etapas até que se chegue a uma definição de valor. Dentre os diversos conceitos de valor, a Norma NB-502/89 (NBR-5676) da ABNT, de Avaliação de Imóveis Urbanos, define valor como sendo aquele fornecido para um bem em um dado instante, único, não importando qual a finalidade da avaliação. Esse valor corresponde ao valor real que se definiria em um mercado de concorrência perfeita caracterizado pelos seguintes silogismos:

a) Igualdade dos bens levados ao mercado;

b) Número elevado de compradores e vendedores, não sendo o mercado alterado por eles;

c) Sem influências externas;

d) Conhecimento pleno e absoluto entre os participantes sobre o bem, o mercado e as tendências deste;

e) Os participantes oferecendo liquidez com plena liberdade de entrada e saída do mercado.

Existem casos onde a necessidade de estimar um valor acontece a nível particular. Assim, as partes envolvidas vendedor e comprador do bem, chegam ao comum acordo da quantidade necessária (moedas) em um determinado instante (Molina). Porém, quando ocorre a necessidade da determinação do valor, de uma maneira mais ampla, isto é, sem ser a nível particular, portanto ampliado a outras pessoas além dos diretamente envolvidos na transação de ordem privada ou pública, procura-se uma perspectiva técnica. Surge, então, a “Ciência da Avaliação”, ou seja, a Engenharia de Avaliações, que infere sobre o valor de um bem de forma fundamentada.

Segundo Barbosa Filho o valor de um bem antes de tudo é um fenômeno social e pode estar associado a um vetor composto por um conjunto de variáveis que abrange todas as suas características físicas, do seu entorno, da sua utilidade e dos fatores subjetivos que a própria coletividade cria no contexto em que está situado a cada instante. Moreira afirma que valor é empregado costumeiramente em diversos sentidos. No entanto, quando é aplicado relativamente à propriedade, a palavra valor demonstra um sentido de posse, domínio ou troca de propriedade, medida em termos de uma unidade monetária.

Fiker afirma que valor é a relação entre a intensidade das necessidades econômicas do homem e a quantidade de bens disponíveis para satisfazê-las, sendo determinado dependendo da oferta e da demanda do bem. Atualmente o valor de mercado de um imóvel é atribuído pelo preço fixado pelo vendedor e comprador. Assim, não são forçados e não estão sujeitos a pressões anormais tendo pleno conhecimento das condições de compra e venda e de como este imóvel deve ser e será utilizado. Contudo, o mercado imobiliário não é, por natureza, de concorrência perfeita. Dessa forma, estima-se o preço médio de mercado, através de uma amostragem de preços que trazem todas as imperfeições deste mercado.

De acordo com a Norma NB-502/89 (NBR-5676) da ABNT, os imóveis são classificados em:

a) Quanto ao uso:

O imóvel urbano pode ser: residencial, comercial, industrial, institucional e misto.

b) Quanto ao tipo do imóvel:

O imóvel urbano pode ser: terreno (lote ou gleba), apartamento, casa, escritório (sala ou andar corrido), loja, galpão, vaga de garagem, misto, hotéis, hospitais, cinemas e teatros, clubes e recreativos.

c) Quanto ao agrupamento:

Os imóveis urbanos se agrupam da seguinte forma: loteamento, condomínio de casas, prédio de apartamentos, conjunto habitacional (casas, prédios ou mistos), conjunto de salas comerciais, prédio comercial, conjunto de prédios comerciais, conjunto de unidades comerciais, shopping-centers e complexo industrial. Este trabalho utilizou dados correspondentes apenas aos imóveis dos tipos: apartamentos, casas residenciais e terrenos.

O Mercado:

Entende-se por mercado o local onde são efetuadas as transações comerciais envolvendo troca de bens, tangíveis ou intangíveis, ou direitos sobre os mesmos. Neste sentido, o termo mercado refere-se àquele de concorrência perfeita e contendo, em geral, as características dos bens. Os participantes do mercado o fazem voluntariamente e têm conhecimento pleno das condições em vigor; nenhum participante, sozinho, é capaz de alterar as condições estabelecidas; cada transação é feita de maneira independente das demais; o número de ofertas e/ou transações é suficientemente grande, de maneira que a retirada de uma amostra não afeta o mercado.

Mercado Imobiliário:

Para Moscovitch, o mercado imobiliário é a jurisdição de determinação dos preços de imóveis urbanos que, como quaisquer outras mercadorias, passam pela medida da oferta e da demanda.

De acordo com Dantas, ele é formado por três secções:

a) a dos imóveis a serem vendidos;

b) a das partes que desejam vendê-los (vendedores);

c) a das partes interessadas em adquiri-los (compradores).

O mercado imobiliário pode ser subdivido ainda, em várias especialidades, tais como a de apartamentos, de casas e de terrenos que foram especificamente analisadas neste trabalho.

Cada mercado tem seu próprio comportamento e suas características específicas. No entanto, existem inúmeras divergências e desigualdades entre os imóveis, que faz o mercado imobiliário comportar-se de forma acentuadamente diferente de outros mercados de bens, devido às características especiais dos imóveis. Por sua localização fixa, qualquer alteração no ambiente provoca modificações no valor do imóvel.

Como as influências não são análogas, as variações provocadas são claramente notáveis, causando progressivamente as diferenças. Por outro lado, como todo bem econômico, a escassez relativa à lei da oferta e procura define o preço dos imóveis. Os governos e as economias globais são grandes influenciadores sobre o preço dos imóveis. E, por sua importância e significado social, as leis propiciam tratamentos especiais.

Dentro do mercado onde ocorrem as transações imobiliárias, identificam-se alguns fenômenos como o dinamismo da atividade imobiliária e o processo de estruturação interna das áreas urbanas. Existem, também, influências externas, que alteram continuamente os valores e usos do solo. O estudo de todos estes fatores constitui o processo de formação de valores, ou seja, como os valores dos imóveis são compostos.

Esses valores muitas vezes sofrem transformações como condições de mercado e também valores que são praticados, devido à falta de ordenação entre empreendedores, intermediários, poder público e também a própria população. Por se tratar de bens econômicos, todas as mudanças que causam maior ou menor disponibilidade refletem em modificações, alterações de valor. Sabe-se que muitas alterações como a oferta de crédito, a inflação, a condução da economia, as políticas fiscais, o crescimento demográfico e a confiança no governo são importantes na flutuação de preços.

No entanto, ocorrerá em certo momento um fenômeno chamado de “equilíbrio instantâneo” resultando num valor de mercado. Todas as variações ocorridas nas condições do mercado são absorvidas e armazenadas pelos imóveis, influenciando seus valores, que oscilam no tempo e no espaço e que, em última análise, são resultados da oferta e demanda por este bem. E assim, outras mudanças na oferta ou na demanda causarão novo equilíbrio, em outros níveis de preço.

Faz-se interessante observar que por existirem inúmeros fatores e influências, uma parte das variações dos valores imobiliários é considerada aleatória, podendo-se pensar no preço final, como baseado em um valor mais provável que aumenta ou diminui por uma parcela imprevisível, de acordo com as influências casuais.

Assim, o valor de um imóvel segue o modelo estatístico,

Y = μ + ε

Onde: Y é o valor negociado;

μ é o valor mais provável, ou seja, E (Y) = μ;

ε é a perturbação estocástica.

Segundo Bráulio, num mercado de concorrência perfeita a situação ideal é aquela onde a oferta e a procura encontra-se equilibrada sendo a relação entre imóvel, vendedor e comprador que são os formadores do mercado, especialmente importantes para a construção do preço. No entanto, pode ocorrer o mercado de concorrência imperfeita, ocasionando casos de monopólio e oligopólio.

Nos casos de monopólio o mercado torna-se comandado por um único vendedor, mas é um caso mais raro de ser encontrado. Entretanto é mais comum ser encontrado casos de oligopólio, onde a oferta é concentrada em um pequeno número de vendedores que também se preocupam com propagandas e qualidade dos imóveis, fazendo com que haja sempre uma alta nos preços dos imóveis. Ocorrem ainda os casos de monopsônio, existindo apenas um comprador e também oligopsônio com muitos compradores (Dantas).

O mercado imobiliário não pode ser considerado um mercado de concorrência perfeita diante de muitas análises teóricas, pois este mercado pode ser visto como uma passagem livre, que os bens são idênticos e que todos os participantes têm as informações perfeitas e que não sofrem nenhuma pressão agindo livremente. No mercado imobiliário, ocorrem fatores que o dificultam: a falta de uniformidade dos imóveis e a falta de informações são exemplos disto. Não se pode esquecer que os altos custos impossibilitam grande parte da população a participar deste mercado de compra e venda, deixando-as ligadas a locação e a financiamentos indisponíveis. Finalmente, pode-se concluir que o mercado imobiliário é um mercado de concorrência imperfeita.

Características dos Imóveis:

Muitos fatores e fontes de divergências diferenciam os imóveis em si: vida útil, localização, singularidade, custos das unidades e tudo isto faz com que o mercado imobiliário tenha um comportamento diferente de outros mercados de bens. Esta combinação de fatores e divergências, em um dado momento, permite explicar grande parte das diferenças de valores entre os imóveis (González e Formoso). O preço de um imóvel é conhecido integralmente. Nele estão orçados os atributos como localização, terreno, área e vida útil.

Assim, os preços dos imóveis podem ser compreendidos como a soma dos produtos das quantidades de cada um desses serviços pelos seus preços implícitos (localização, área, terreno e vida útil). Ao final, é importante verificar que, por existirem inúmeras influências, uma parte das variações dos valores imobiliários pode ser considerada aleatória, ou seja, pode-se pensar no preço final como baseado em um “valor mais provável” que é sujeito a variações, de acordo com as influências pontuais do caso e conforme o modelo

Métodos de Avaliação:

A escolha da metodologia mais apropriada para uma dada avaliação depende das condições atuais do mercado, do tipo de serviço a que se presta e da precisão que se deseja. No entanto, independentemente da metodologia utilizada, essa deverá apoiar-se em pesquisa de mercado e considerar os preços comercializados e/ou ofertados, bem como outros elementos e atributos que influenciam o valor (NBR-5676/90). De acordo com Montenegro Duarte, a avaliação como ciência usada para encontrar um valor, não é exata, mas pode ser altamente precisa.

Deve ser objetiva e esclarecedora, identificando o bem a ser avaliado e o método a ser utilizado e quando realizada de forma científica, ou seja, baseada em teorias e métodos adequados, utiliza instrumental tecnológico próprio buscando a objetividade. Assim os resultados das estimativas realizadas por diferentes grupos de avaliadores, deverão ser próximos uns dos outros. Desta forma, podem-se definir as metodologias de avaliação como formas de se atribuir valor a um imóvel. De acordo com a ABNT (NBR-5676/90), os métodos de avaliação são divididos em dois grandes grupos: métodos diretos e métodos indiretos. A seguir são apresentados detalhamentos desses métodos.

a) Métodos Diretos:

Quando o valor do resultado da avaliação independe de outros, o método é chamado de direto (Dantas). Os métodos diretos se subdividem:

Método comparativo de dados:

É um método que define o valor de comparação com dados de mercado que são semelhantes quanto a características peculiares ou não. É o método mais indicado para trabalhos de avaliação, porém para a sua aplicação, existe uma condição fundamental que é a existência de um conjunto de dados que possa ser utilizada, estatisticamente, como amostra de mercado imobiliário. As características e os atributos dos dados pesquisados que exercem influência na formação dos preços, devem ser ponderados por homogeneização ou por dedução estatística, respeitados os níveis de rigor definidos nessa norma.

Método comparativo de custo de reprodução de benfeitorias:

É o método que apropria o valor das benfeitorias, através da reprodução dos custos de seus componentes. Estes custos são compostos com base em orçamento detalhado em função da avaliação realizada. Devem ser justificados e quantificados os efeitos do desgaste físico e do obsoletismo funcional das benfeitorias. A utilização dos métodos diretos tem preferência e sempre que existirem dados suficientes para utilização do método comparativo ele deve ser escolhido (Dantas)

b) Métodos Indiretos:

O método é considerado indireto quando necessita de resultados provenientes de outro procedimento. Os métodos indiretos são:

O método da renda:

Avalia o valor do imóvel ou de suas partes componentes em função de um rendimento já existente ou previsto pelo bem no mercado, ou seja, o valor econômico do bem.

Método involutivo:

O valor do terreno é estimado por estudos da viabilidade técnica-econômica do seu aproveitamento, considerando como aproveitamento eficiente à realização de um empreendimento imobiliário hipotético compatível com as características do imóvel e com as condições do mercado (Moreira Filho, Frainer e Moreira)

Método residual:

Obtém-se o valor do terreno a partir da diferença entre o valor total do imóvel e o valor das benfeitorias, levando-se em conta o fator de comercialização (Fiker). Analisando os vários métodos de avaliação, mostrados anteriormente, pode-se observar que de uma forma, ou de outra, todos são comparativos. Sendo assim, Dantas, 1998, explica que no método comparativo comparam-se bens semelhantes; no método de custo, comparam-se os próprios custos no mercado; nos métodos da renda e involutivo compara-se à possibilidade de renda do bem; e no método residual, compara-se o nível de comercialização do mercado.

O método comparativo, quando utilizado, permite que se tenha uma estimativa mesmo com as diferentes tendências de mercado. Ele estima o valor baseado na comparação com outros semelhantes, iniciando de um grupo de dados e somando-se com outras informações resultando numa amostragem estatística de dados do mercado imobiliário. Portanto, o método comparativo de dados de mercado é o método mais utilizado e indicado para avaliações de mercado.

Na prática, geralmente ocorre a falta de algum componente que influencie no valor final do imóvel e isto faz com que a semelhança entre o imóvel avaliado e os componentes da amostra seja imperfeita e incompleta. Assim, os atributos dos dados pesquisados que influenciam o valor devem ser ponderados por homogeneização ou inferência estatística, respeitando os níveis de rigor definidos na NBR-5676/89. Com o uso de técnicas estatísticas obtém-se uma avaliação isenta de subjetividade e de grande confiabilidade (Moreira Filho, Frainer e Moreira; González e Formoso).

Tabelas e também modelos de preços hedônicos, tais como a regressão linear múltipla, são utilizados para estimar valores. No entanto, ambos sofrem contestações sobre sua eficácia. As tabelas que eram tradicionalmente utilizadas são criticadas por serem imprecisas e de pouca confiabilidade. A regressão linear múltipla tem demonstrado sérios problemas de multicolinearidade nas variáveis explicativas e também de inclusão de outlier na amostra.

Além disso, a colinearidade dentro dos dados pode tornar a regressão linear múltipla um modelo inadequado para um mercado que requer respostas rápidas e de alta precisão, sendo aceitável apenas quando realizada por um profissional capacitado (Worzala, Lenk e Silva).

Neste trabalho procura-se evitar o problema da multicolinearidade trabalhando-se com componentes principais.

Nível de Precisão da Avaliação:

Os níveis de precisão que caracterizam uma determinada avaliação são normatizados pela NBR-5676/90. De acordo com NBR-5676, em seu item 7, o nível de rigor almejado numa dada avaliação está diretamente relacionado com as informações extraídas do mercado. Sendo assim, a precisão do mercado será determinada por esse nível que será maior ou menor, dependendo da avaliação. Este rigor relaciona-se diretamente com a abrangência da pesquisa, à confiabilidade e adequação dos dados coletados, à qualidade do processo avaliatório e ao grau de subjetividade do avaliador. Desta forma, os trabalhos avaliatórios podem, de acordo com a norma, ser classificados como de nível de rigor expedito, normal, rigoroso e rigoroso especial.

Rigor expedito: o valor é obtido sem a utilização de qualquer instrumento matemático, apenas com o nível de conhecimento de mercado do avaliador. É muito freqüente, porém não é este o objetivo deste trabalho. A ausência de método científico determina que o valor seja atribuído através de escolha arbitrária, não caracterizando o aspecto técnico da avaliação.

Rigor normal: para esta avaliação utilizam-se métodos estatísticos e existem exigências com relação à coleta e tratamento dos dados.

Rigorosa: nestas avaliações os dados devem se basear em processos estatísticos que permitam calcular estimativas não tendenciosas do valor, tendo a total isenção de subjetividade. O resultado final da avaliação, através do tratamento estatístico adotado, deve estar contido em um intervalo de confiança fechado e com um nível de confiança máximo de 80%, desde que as hipóteses nulas sejam testadas ao nível de significância máximo de 5%.

Rigorosa especial: caracteriza-se pelo encontro de um modelo estatístico o mais abrangente possível, ou seja, que incorpore o maior número de características que contribuem para a formação do valor.

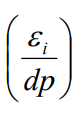

A função estimada da formação de valor deve ser eficiente e não tendenciosa. Portanto, a hipótese nula da equação de regressão deve ser rejeitada ao nível de significância máximo de 1% (ANOVA). Já as hipóteses nulas sobre os parâmetros do modelo de regressão ao nível de significância máximo de 10% para o teste unicaudal (teste “t”) ou 5% em cada ramo do teste bicaudal. Devem ser analisadas as seguintes condições básicas referentes aos resíduos do modelo ajustado aos dados: Gaussianidade, homogeneidade da variância e independência.

Desta forma os resíduos devem ser Gaussianos, independentes e identicamente distribuídos, ou seja, εi ~ N (0, σ 2 ). Logo, deve-se testar a Gaussianidade por um método adequado. Os mais usados são: o teste de Shapiro-Wilks e o de Kolmogorov-Smirnov. A homogeneidade da variância das variáveis pode ser verificada graficamente por meio do gráfico dos resíduos contra os valores ajustados, ou seja, 1, 2, ..., . ^ ^ x y i n ε i i = E, a premissa da independência dos resíduos pode ser identificada por meio do gráfico dos resíduos contra a ordem, ou seja, i i x ^ ε .

3 ANÁLISE MULTIVARIADA:

Ao se tomar uma decisão, muitos fatores costumam estar envolvidos nela; certamente nem todos têm a mesma importância. Quando a intuição é utilizada nessa tomada de decisão, nem todos os fatores costumam ser identificados, ou seja, não serão definidas as variáveis que afetam a decisão. Assim também, nota-se que um grande número de variáveis envolve os acontecimentos sejam eles culturais ou naturais.

Muitas ciências buscam conhecer a realidade e, assim, interpretar os acontecimentos e fenômenos baseados no conhecimento das variáveis intervenientes consideradas importantes nestes eventos. A finalidade da ciência é estabelecer relações e encontrar ou propor leis explicativas. Para isso é necessário absorver todas as informações que são consideradas mais relevantes para obter o entendimento do fenômeno analisado.

São diversas as dificuldades encontradas na transformação das informações (dados) obtidas em conhecimento. Porém, a maior delas é de natureza epistemológica: a ciência que tenta representar a realidade através de modelos e teorias dos diversos ramos do conhecimento. Outra dificuldade é a aspiração de universalidade das explicações científicas, resultando desta forma, ao condicionamento da pesquisa a uma “padronização” metodológica, tendo um aspecto essencial que é a avaliação estatística das informações.

A cada dia amplia-se cientificamente a facilidade de obtenção de informações sobre acontecimentos e fenômenos que estão sendo analisados, sendo que estas informações são parcelas de dados que devem ser trabalhados e processados e então transformados em conhecimentos. Assim, cada vez mais surge a necessidade da utilização de ferramentas estatísticas que apresentem uma visão por inteiro sobre o fenômeno analisado e que melhore as informações obtidas com uma abordagem univariada.

A designação “Análise Multivariada” corresponde a um conjunto de técnicas que utiliza simultaneamente todas as variáveis que caracterizam um item na análise estatística. Assim, ao invés de trabalhar com uma variável explicativa X ela considera o vetor X cujas componentes são variáveis aleatórias explicativas. A metodologia da Análise Multivariada detém um grande potencial de aplicação, pois facilita o entendimento do relacionamento entre as diversas variáveis aleatórias.

As técnicas multivariadas, são técnicas que não tratam apenas uma dimensão de análise de dados, mas também uma escala de cruzamento entre várias dependentes ou não e também um cruzamento de dados que envolvem informações dependentes, oferecendo assim ao pesquisador, uma nova dimensão, mais abundante que normalmente em abordagem univariada.

A estatística univariada clássica fixou-se no estudo de uma única característica (ou variável) medida para um conjunto pequeno de indivíduos, desenvolvendo as noções de estimativa e de testes fundamentados em hipóteses muito restritivas. Entretanto, na prática, os indivíduos observados são freqüentemente caracterizados por um grande número de características (ou variáveis).

Os métodos de análise de dados permitem um estudo global dessas variáveis, pondo em evidência ligações, semelhanças ou diferenças. Por isso, “mergulham-se” indivíduos e variáveis em espaços geométricos, fazendo-se a máxima economia de hipóteses, e transformam-se os dados para visualizá-los num plano ou classificá-los em grupos homogêneos, perdendo o mínimo de informações. A Análise Multivariada é a parte da estatística que estuda, interpreta e elaboram o material estatístico sobre um conjunto de n > 1 variáveis (quantitativa e/ou qualitativa).

Os dados onde cabe uma Análise Multivariada são, portanto, de caráter multidimensional (Cuadras). Pode ser usada para a redução ou simplificação de dados, distribuição e agrupamentos, investigação da dependência entre variáveis, predição, teste de hipótese, e muitas outras.

Pla aponta alguns dos objetivos mais importantes dos métodos multivariados:

a) Encontrar a adequação de representar o universo em estudo, simplificando a estrutura dos dados. Pode-se obter através da transformação (combinação linear ou não linear) de um conjunto de variáveis interdependentes em outro conjunto independente e/ou num conjunto de menor dimensão.

b) Classificação; esta análise permite estabelecer as observações dentro de grupos ou, então, concluir que os indivíduos estão aleatórios no multi-espaço, sendo também possível, alocar novos itens em grupos identificados.

c) Análise da interdependência; tem como objetivo examinar a interdependência entre as variáveis, a qual abrange desde a independência total até a colinearidade quando uma delas é combinação linear de outras ou, em termos mais gerais, é uma função f (x) qualquer das outras.

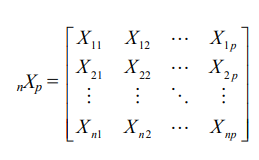

De acordo com Johnson e Wichern, em problemas que envolvem p variáveis (p > 1), tomando-se n observações de cada vetor aleatório X de dimensão p tem-se que as medidas observadas xij, com i = 1, 2,... , n e j = 1, 2,... , p, podem ser arranjadas em uma matriz de dados genérica de ordem n x p, nXp.

A representação da matriz de dados correspondente a n observações do vetor X’ = [X1, X2,..., Xp] de dimensão p, composto por p varáveis aleatórias, pode ser nXp = (Xij). No entanto, essa matriz corresponde a uma amostra aleatória de tamanho n do vetor pdimensional X, ou seja, [x1, x2, x3,..., xn].

Na grande maioria das vezes, quando se estuda áreas de pesquisas e aplicação de técnicas estatísticas, várias características (variáveis) são observadas. Essas variáveis devem ser analisadas em conjunto por não serem independentes e a Análise Multivariada é a área que trata desse tipo de análise e visa trabalhar, conjuntamente, com mais do que uma variável. As técnicas multivariadas mais utilizadas são aquelas relacionadas ao estudo da estrutura de covariância do vetor observado, ao estudo do agrupamento de itens e ao estudo do reconhecimento de padrões e classificação.

Especificamente pode-se citar: Análise de Componentes Principais, Análise Fatorial, Análise de Correlação Canônica, Análise de Agrupamento (Cluster Analysis) e Reconhecimento e Classificação de Padrões. Várias são as técnicas que podem ser aplicadas aos dados. Sua utilização depende do tipo de dados que se deseja analisar e dos objetivos do estudo. Nesta pesquisa trabalhou-se com as seguintes técnicas multivariadas:

- Análise de Agrupamentos;

- Análise de Componentes Principais;

- Reconhecimento de Padrões e Classificação.

Estatísticas Descritivas Multivariadas:

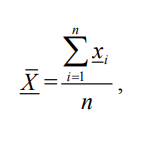

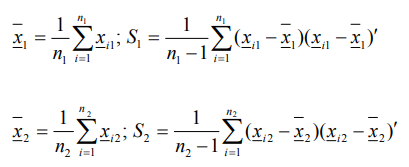

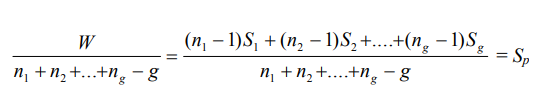

A Ciência Estatística trabalha com amostras. As informações amostrais podem ser resumidas em números sumários conhecidos como estatísticas e que podem constar nas observações multivariadas [x1, x2, x3, ..., xn]. As estatísticas são usadas na inferência sobre os parâmetros, ou seja, na estimação do vetor médio μ, da matriz de covariância Σ ou da matriz. de correlação ρ, entre outros. De maneira que o vetor médio populacional μ deve ser estimado pelo vetor médio amostral, X , definido pela expressão,

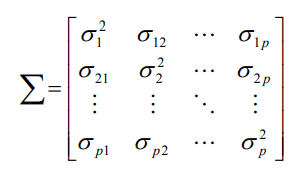

onde xi com i = 1, 2, ..., n corresponde às observações amostrais do vetor X e n é o tamanho da amostra observada. Outros parâmetros de uma população multivariada f(x) podem ser avaliados, tais como a matriz de covariância Σ, definida por:

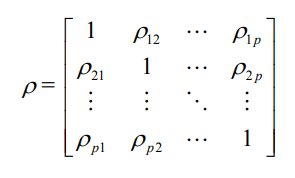

onde se tem na diagonal principal as variâncias das variáveis aleatórias e, fora da diagonal principal, as covariâncias entre elas. E, a matriz de correlação ρ, definida por:

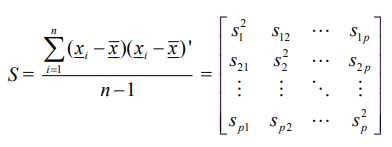

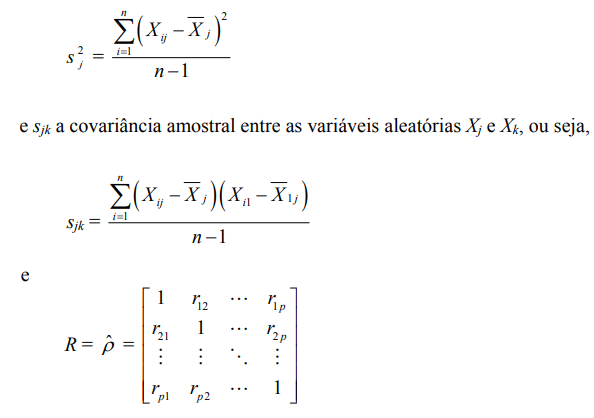

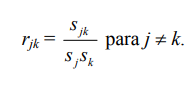

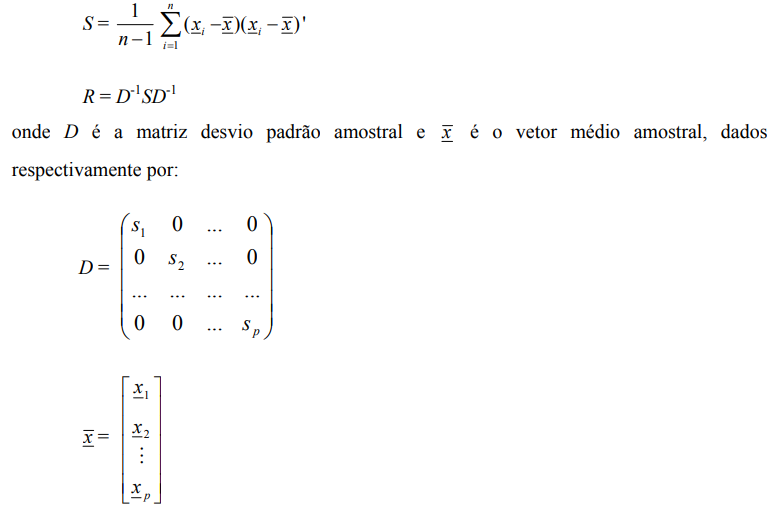

com as correlações entre as variáveis fora da diagonal principal. Então estes parâmetros, Σ e ρ, são estimados, respectivamente, pela matriz de covariância amostral S e pela matriz de correlação amostral R ou ρˆ , cujas expressões são:

sendo s 2 j a variância amostral da variável aleatória Xj,

com as correlações amostrais fora da diagonal principal e dadas pelo quociente entre a covariância amostral e o produto dos desvios padrões amostrais, ou seja:

Esses estimadores são os melhores para se determinar os parâmetros. Os primeiros são EUMV (Estimador Uniformemente de Mínima Variância) e o último é EMV (Estimador de Máxima Verossimilhança).

Métodos Multivariados:

Métodos Multivariados são técnicas estatísticas importantes cujo uso está particularmente disseminado nas ciências físicas, sociais e médicas. É também complexa porque é difícil de identificar técnicas que são projetadas para estudar relações dependentes e interdependentes. Existem vários métodos de Análise Multivariada, com diversas finalidades. Portanto, é necessário saber que tipo de conhecimento se pretende gerar. Os métodos estatísticos são escolhidos de acordo com os objetivos da pesquisa. Aplicou-se neste trabalho alguns destes métodos sendo detalhados nas próximas seções.

Análise de Componentes Principais:

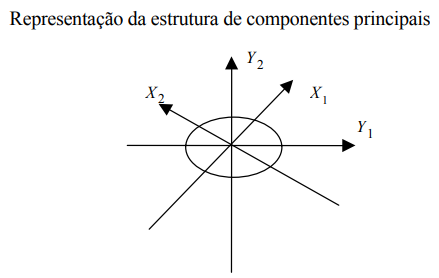

O método das Componentes Principais procura explicar a estrutura da variância e covariância de um vetor aleatório através de poucas combinações lineares das variáveis originais. Seu objetivo geral baseia-se tanto em reduzir os dados como em facilitar a interpretação, pois consiste numa transformação, de eixos, tornando as novas variáveis (combinações lineares) não correlacionadas.

De forma que uma matriz de dados X de ordem n x p pode ser substituída por outra de ordem n x m sendo m << p. De acordo com Johnson e Wichern, embora as p componentes sejam necessárias para reproduzir toda a variabilidade presente na estrutura de covariância do vetor X de dimensão p, freqüentemente, uma grande parte desta variabilidade poderá ser explicada por um número m < p de Componentes Principais. Neste caso existe praticamente a mesma quantidade de informações nas m Componentes Principais do que nas p variáveis originais. A Análise das Componentes Principais freqüentemente revela relações que não eram previamente consideradas e assim permitem interpretações que não iriam, de outro modo, aparecer.

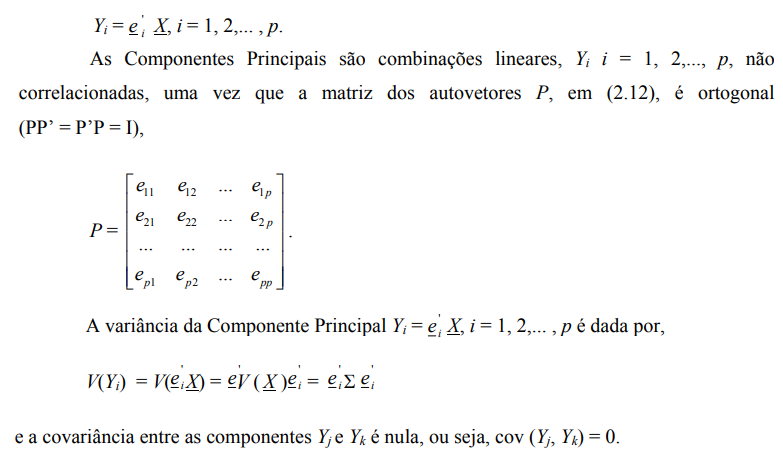

a) Componentes Principais Populacionais:

Algebricamente, as componentes principais são combinações lineares das p variáveis originais X1, X2,..., Xp que compõem o vetor aleatório X. Geometricamente, as combinações lineares representam a seleção de um novo sistema de coordenadas, obtido por rotação do sistema original, sendo que os novos eixos representam as direções com variabilidade máxima. Como exemplo, tem-se, na figura 2.1, a representação da estrutura de componentes principais para p = 2:

onde:

X1 e X2 são eixos originais.

Y1 e Y2 são novos eixos (eixos originais rotacionados: centrado na média amostral).

Obtêm-se as Componentes Principais a partir da matriz de covariância Σ ou da matriz de correlação ρ, que resumem a estrutura de relacionamento das p variáveis originais que compõem o vetor X. Então, da matriz de covariância ∑ ou da matriz de correlação ρ, obtém-se os autovalores λ1 > λ2 > ..... > λp e os respectivos autovetores e1, e2,... , ep. E, com estes entes algébricos se constrói as combinações lineares que definem as componentes principais, ou seja,

Portanto define-se:

- A primeira componente principal como a combinação linear Y1 = e X' 1 que maximiza a variância de Y1, sob a restrição e ' 1 e 1 = 1.

- A segunda componente principal como a combinação linear Y2 = e X' 2 que maximiza V (e X ) ' 2 sujeita a restrição 1 2 ' 2 e e = e cov( , ) 0

- A i-ésima componente principal como a combinação linear Yi = e Xi ' que maximiza V (e X ) i ' sujeita a restrição 1 ' e ei = i e cov(Y , Y ) 0 k i.

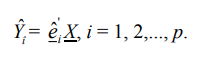

b) Componentes Principais Amostrais:

Comumente os parâmetros da estrutura de covariância, Σ ou ρ, são desconhecidos. Então, a obtenção das componentes principais é feita a partir de seus estimadores, que são a matriz de covariância amostral S ou a matriz de correlação amostral R. Estas estatísticas são definidas por:

Então, obtêm-se as estimativas dos elementos da estrutura de covariância do vetor aleatório X, ou seja, os autovalores ˆ λi i = 1, 2,..., p e os correspondentes autovetores ˆi e e constroem-se as componentes principais amostrais:

As propriedades das componentes principais se mantêm e são obtidas com base em estimadores. A obtenção das componentes principais com base nas informações da matriz de correlação é preferida, devido ao fato de se conseguir eliminar o efeito de escala nos valores das componentes do vetor de variáveis originais X. A matriz de correlação é uma matriz de covariância, mas de variáveis padronizadas.

Assim, consegue-se eliminar a influência da escala das variáveis na magnitude das variâncias. Os autovetores definem as direções da máxima variabilidade e os autovalores especificam as variâncias. Eles são a essência do método das componentes principais. Quando os primeiros autovalores são muito maiores que os demais, a maior parte da variância total pode ser explicada por um número menor do que as p dimensões do vetor X. O desenvolvimento da Ciência Estatística, com o passar do tempo, favoreceu o aparecimento de outro método de extração dos fatores de uma Análise Fatorial, que é o da máxima verossimilhança. Os dois métodos estão disponíveis nos modernos programas computacionais.

c) Critérios para Definição do Número de Componentes Principais Extraídas:

Um critério para a determinação do número de componentes a serem extraídas foi sugerido por Kaiser em 1960. Segundo Johnson e Wichern, Kaiser propôs escolherem-se somente as componentes correspondentes aos autovalores (raízes latentes) de magnitudes maiores do que um. Outra maneira de se definir o número de componentes é através da percentagem de variação explicada.

O pesquisador, neste caso, deve julgar se m componentes explicam suficientemente o relacionamento entre as p variáveis originais. Geralmente, um bom grau de explicação é superior a 75% para um m pequeno. Um procedimento que visualiza muito bem o Critério de Kaiser é grafar os autovalores contra o número de componentes na ordem de extração (Scree Plot). Fixando-se um nível de corte fica fácil decidir o número de m. Uma propriedade muito importante das Componentes Principais é a independência entre elas. Desta forma, podem substituir as variáveis originais e eliminar o problema de multicolinearidade.

Análise de Agrupamento (Clusters Analysis):

É uma técnica multivariada que busca a formação de grupos homogêneos de objetos ou variáveis. Estes grupos são formados calculando-se as distâncias entre os itens, representados por vetores compostos pelas suas características, construindo-se uma matriz de distâncias e juntando os itens em grupos de acordo com suas proximidades. Segundo Crivisqui os chamados Métodos de Agrupamento, ou Cluster Analysis, ou ainda Métodos de Classificação Automática, são métodos estatísticos destinados a dividir em subconjuntos um conjunto de dados observados.

Aplicar estes métodos significa definir nesse conjunto as classes em que se distribuem os elementos do conjunto. Se n indivíduos sobre os quais se observaram p características estão representados num espaço de p dimensões, chamam-se classes aos subconjuntos de indivíduos desse espaço de representação que são identificáveis. Não se pode requerer a existência de classes num conjunto de observações.

Só é possível verificar a existência de níveis de síntese significativos correspondentes à organização em classes e subclasses dos elementos, de modo que os elementos de uma matriz de dados qualquer não são necessariamente classificáveis. Por isso, é necessário explorar previamente a estrutura da informação disponível, antes de orientar-se em direção a um algoritmo de classificação.

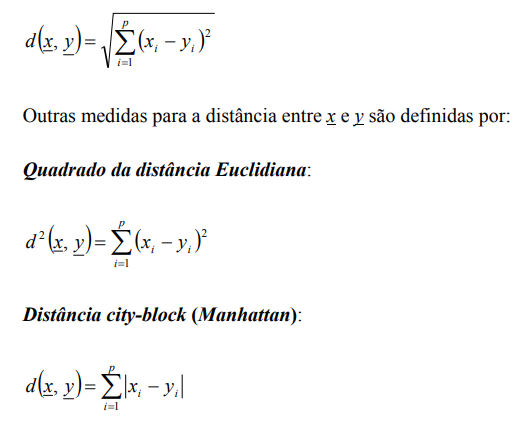

a) Medidas de similaridade e dissimilaridade:

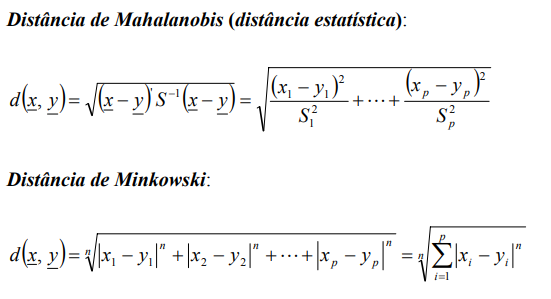

Quando são agrupados itens, a proximidade é usualmente indicada por uma espécie de distância. Por outro lado, as variáveis são usualmente agrupadas com base nos coeficientes de correlação ou outras medidas de associação. Assim, quanto maior ou menor o valor do índice de similaridade ou dissimilaridade mais ou menos parecidos são os objetos. Existem vários índices de similaridades, sendo que a sua principal medida é o coeficiente de correlação. No entanto, os itens podem sem comparados por uma distância. Existem várias métricas que podem ser usadas:

Distância Euclidiana: é, simplesmente, a distância geométrica no espaço Multidimensional. A distância entre os itens x e y é definida por:

b) Método de agrupamento hierárquico:

A utilização deste método segue o seguinte procedimento: iniciam-se com g grupos, sendo que cada um é formado por um único objeto; calcula-se a matriz simétrica de distâncias n × n, D = (dij), onde dij é a distância ou similaridade entre o objeto i e o objeto j, onde: d11 = d22 = ... = dnn = 0. Na matriz de distâncias D, acha-se o par de grupos mais próximo (menor distância) e juntam-se os grupos. O novo grupo formado é, por exemplo, (AB). Nova matriz de distâncias é construída, simplesmente apagando-se as linhas e colunas correspondentes aos grupos A e B e adicionando-se a linha e a coluna dadas pelas distâncias entre (AB) e os grupos remanescentes. Repetem-se estes passos anteriores, num total de (g – 1), vezes observando-se as identidades dos grupos que são agrupados.

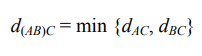

A função de um item ou grupo a outro grupo é feita usando-se um tipo de procedimento chamado ligação. Os tipos de ligações mais comuns são: Ligação Simples (vizinho mais próximo), Ligação Completa (vizinho mais distante), Método de Ward, Método das Médias das Distâncias e Método do Centróide. A seguir serão detalhados os três primeiros tipos de ligações.

Ligações Simples (vizinho mais próximo):

Nesta ligação o agrupamento é feito juntando-se dois grupos com menor distância ou maior similaridade. Quando formado o novo grupo, por exemplo, (AB), na ligação simples, a distância entre (AB) e algum outro grupo C é calculado e os resultados são apresentados graficamente em um diagrama de árvore ou dendrograma.

Ligação Completa (vizinho mais longe):

O procedimento é muito semelhante ao da ligação simples, com uma única exceção: o algoritmo aglomerativo começa determinando a menor distância dik, constrói-se a matriz de distâncias D = (dik) e os grupos vão se juntando. Se A e B são dois grupos de um único elemento, tem-se (AB) como novo grupo. A distância entre (AB) e outro grupo C é dada por:

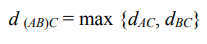

Método de Ward:

Este método é usado, avaliando a perda de informações utilizando o critério da soma ao quadrado dos erros, (SQE), entre dois agrupamentos, para todas as amostras. Quando se tem a distância mínima unem-se os grupos próximos, e volta-se a iterar nos grupos. Então tem-se:

Os resultados são fornecidos na forma de dendrograma e o eixo vertical dá os valores de SQE. A decisão do número de classes ou tipos para análise é tomada a partir do exame do dendrograma ou árvore hierárquica, onde podem ser lidos os índices de nível ou índices de similaridade que são as distâncias euclidianas em que ocorrem as junções dos pontos observados para formar grupos. Uma grande distância indica que a agregação reuniu dois grupos muito dissimilares e, por isso, deve-se definir o número de grupos anterior a esta distância.

Discriminação, Classificação e Reconhecimento de Padrões:

Estatisticamente, a construção e a avaliação de regras de reconhecimento e classificação de padrões podem ser baseadas em três métodos principais: Função Discriminante Linear de Fisher, Regressão Logística e Método das k-médias. Posteriormente, surgiu a tecnologia de Redes Neurais (tecnologia emergente), métodos de Programação Matemática e outros métodos para formação do conjunto de procedimentos usados no reconhecimento e classificação de objetos e indivíduos. Abaixo se detalha o método da Análise Discriminante.

Análise Discriminante:

Segundo Johnson e Wichern, é uma técnica multivariada que tem por objetivo tratar dos problemas relacionados com separar conjuntos distintos de objetos (itens ou observações) e alocar novos objetos em conjuntos previamente definidos. Quando empregada como procedimento de classificação não é uma técnica exploratória, uma vez que ela conduz a regras bem definidas, as quais podem ser utilizadas para classificação de outros objetos.

Tem como objetivos imediatos, quando usada para discriminação e classificação, os seguintes:

- Descrever algébrica ou graficamente as características diferenciais dos objetos (observações) de várias populações conhecidas a fim de achar “discriminantes” cujos valores numéricos sejam tais que as populações possam ser separadas tanto quanto possível.

- Agrupar os objetos (observações) dentro de duas ou mais classes determinadas. Tenta-se encontrar uma regra que possa ser usada na alocação ótima de um novo objeto (observação) nas classes consideradas.

- Uma função que separa pode servir para alocar um objeto e, da mesma forma, uma regra alocadora pode sugerir um procedimento discriminatório. Na prática, os objetivos 1 e 2, freqüentemente, sobrepõem-se e a distinção entre separação e alocação torna-se confusa.

Discriminação e Classificação:

Método de Fisher:

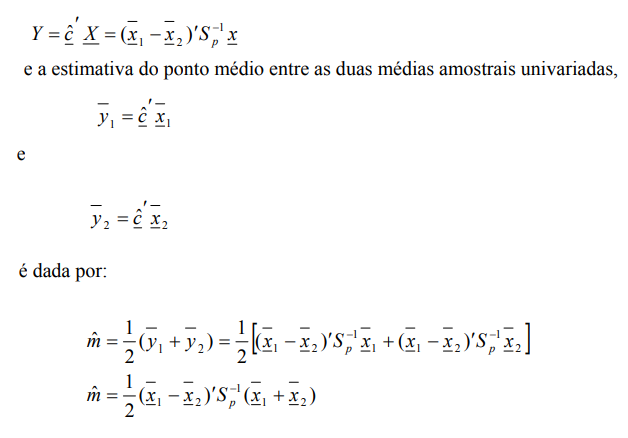

1. Método de Fisher para Duas Populações:

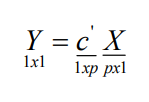

A ideia de Fisher foi transformar as observações multivariadas X’s em observações univariadas Y’s tais que os Y’s das populações π1 e π2 sejam separados tanto quanto possível. Fisher tomou combinações lineares de X para criar os Y’s, dado que as combinações lineares são funções de X e por outro lado são de fácil cálculo. Assim, sendo μ1y a média dos Y’s obtidos dos X’s pertencentes a π1 (população 1) e μ2y a média dos Y’s obtidos dos X’s pertencentes a π2 (população 2), Fisher selecionou a combinação linear que maximiza a distância quadrática entre μ1y e μ2y relativamente à variabilidade dos Y’s. Assim, seja:

- μ1 = E (X|π1) = valor esperado de uma observação multivariada de π1.

- μ2 = E (X|π2) = valor esperado de uma observação multivariada de π2.

e supondo a matriz de covariância

Σ = Ε [(Χ − μi)(Χ − μi)’] i = 1, 2

como sendo a mesma para as duas populações, e ainda considerando a combinação linear,

tem-se:

μ1y = E (Y |π1) = E (c’X |π1) = c’E (X |π1) = c’μ1,

μ2y = E (Y|π2) = E (c’X |π2) = c’E (X |π2) = c’μ2

e

V (Y) = 2 σ y = V (c’X) = c’ V (X) c = c’Σc,

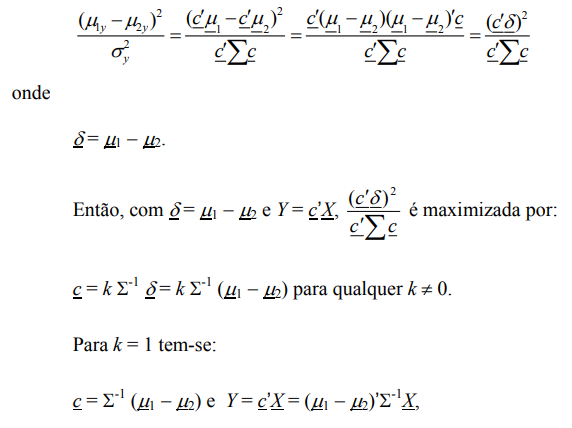

que é a mesma para ambas as populações. Então, segundo Fisher, a melhor combinação linear é a derivada da razão entre o “quadrado da distância entre as médias” e a “variância de Y”.

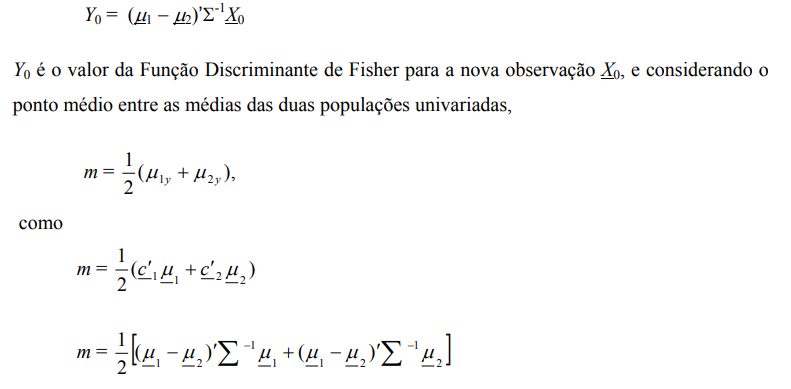

que é conhecida como Função Discriminante Linear de Fisher. Ela transforma as populações multivariadas π1 e π2 em populações univariadas, tais que as médias destas populações são separadas tanto quanto possível relativamente à variância populacional, considerada comum. Logo, para classificar a observação multivariada X0 usa-se o modelo:

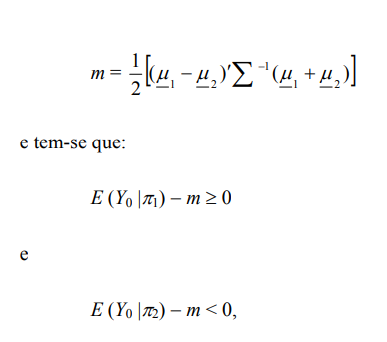

ou seja, se X0 pertence a π1, se espera que Y0 seja igual ou maior do que o ponto médio. Por outro lado se X0 pertence a π2, o valor esperado de Y0 será menor que o ponto médio. Portanto, a regra de classificação é:

alocar x0 em π1 se y0 − m ≥ 0

alocar x0 em π2 se y0 − m < 0

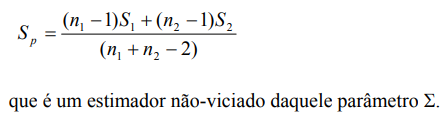

Os parâmetros μ1, μ2 e Σ geralmente são desconhecidos. Então, supondo que se tem n1 observações da v.a. multivariada X1 de dimensão p, ou seja, tem-se uma amostra aleatória da população π1 e n2 observações da v.a. multivariada X2 de dimensão p, que corresponde a uma mostra aleatória da população π2, os resultados amostrais correspondentes são:

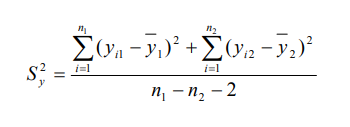

Assumindo que as populações sejam assemelhadas, é natural considerar a variância como a mesma daí estima-se a matriz de covariância comum Σ pela matriz de covariância amostral calculada com a amostra conjunta,

Conseqüentemente, a Função Discriminante Linear de Fisher Amostral é dada por:

Finalizando a regra de classificação é a seguinte:

y0 − mˆ ≥ 0 x0 é alocado em π1

y0 − mˆ < 0 x0 é alocado em π2

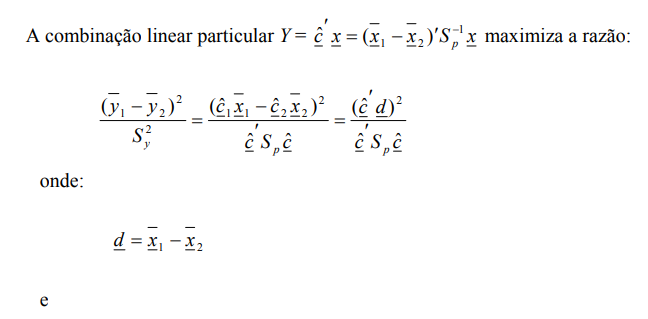

Discriminação entre Diversas Populações:

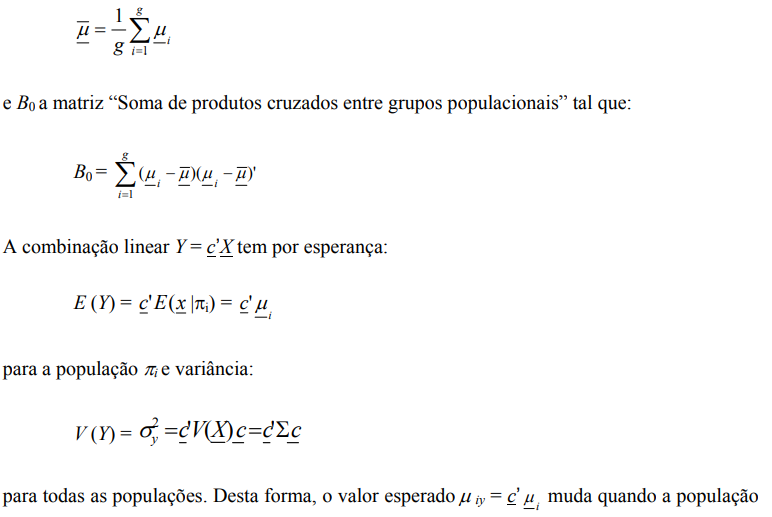

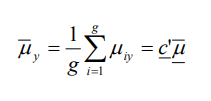

O método anterior válido para duas populações pode ser estendido para diversas populações. O primeiro objetivo de Fisher com o método foi o de separar populações, podendo ser usado também para classificar novos itens em uma das populações. Esse método não necessita da suposição de que as diversas populações sejam normais multivariadas, porém, é necessário assumir que as matrizes de covariâncias populacionais são iguais, ou seja, Σ1 = Σ2 = ... = Σg = Σ. Assim, seja μ o vetor médio dos diversos grupos (populações),

para todas as populações. Desta forma, o valor esperado μ iy = c’ i μ muda quando a população da qual X é selecionado é outra. Tem-se então uma média global:

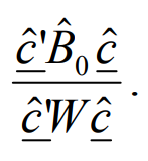

e a razão entre a “Soma dos quadrados das distâncias das populações para a média global” e a variância de Y’ é

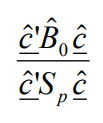

que é uma generalização multigrupal do caso de duas populações. Medindo a variabilidade entre grupos de valores (escores) Y relativamente à variabilidade comum dentro dos grupos, da mesma forma do que no caso de duas populações, pode-se selecionar c que maximiza esta razão. É conveniente normalizar c tal que 1. ' c ∑c =1.

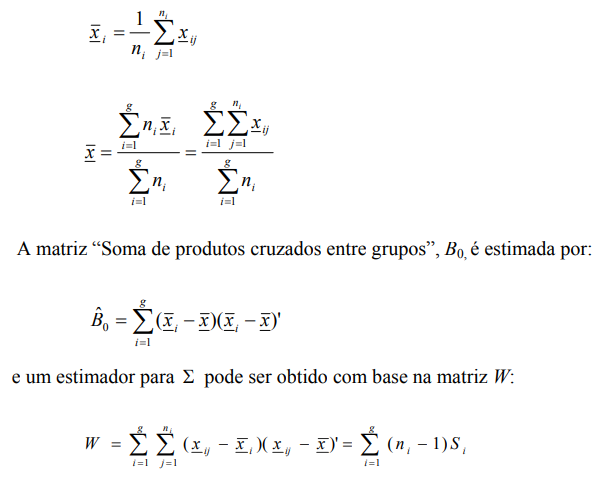

Sejam λ1 ≥ λ2 ≥ ... ≥ λs > 0 os s ≤ min (g – 1 p) autovalores não-nulos de Σ-1B0 e e1, e2,..., es os correspondentes autovetores (escalonados tal que e e 'Σ = 1). Então, é fácil provar que o vetor de coeficientes c que maximiza a razão cBc c c ' ' 0 Σ é dado por c1 = e1. A combinação linear c1’X é chamada primeiro discriminante e de forma idêntica, pode-se generalizar para o k-ésimo discriminante com ck = ek com k = 1, 2,..., s. Geralmente, Σ e μi não são conhecidas, toma-se amostras aleatórias de tamanhos ni das populações πi, i = 1, 2,..., g e denotando o conjunto de dados da população πi, i = 1, 2,..., g, por niXp tem-se os estimadores dos parâmetros μi e μ dados por:

Consequentemente:

Assim, o mesmo cˆ que maximiza a razão

também maximiza

Logo, apresentar-se-á o otimizante c$ na forma mais usual, que é o autovetor e$i da matriz W-1B0, porque se W-1B0 e$ = $ λe$ então Sp -1 B e n n n g e g ( ... )ˆ ˆ ˆ ˆ 0 = λ 1 + 2 + + − , portanto, concluindo que sejam λ1 ≥ λ2 ≥ ... ≥ λg > 0 os autovalores não nulos de W-1B0 e s eˆ , eˆ ,.....,eˆ 1 2 os correspondentes autovetores, sendo s ≤ min (g – 1, p) e e$i normalizado tal que eS e $ $ i p i = 1; então o vetor de coeficientes que maximiza a razão citada acima é c$ 1 =e$1 e a combinação linear e$1 ’x é chamada primeiro discriminante amostral. Generalizando, tem-se no passo k o késimo discriminante amostral e x $ ' k , k ≤ s.

Avaliação de Funções de Reconhecimento e Classificação:

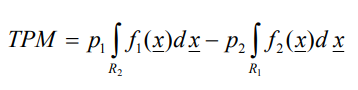

1. Critério TPM (Total Probability of Misclassification):

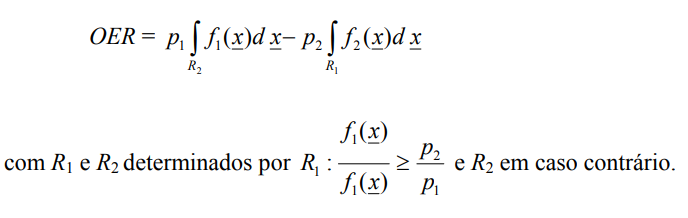

A TPM é dada por:

onde: p1 e p2 são as probabilidades de uma observação pertencer a π1 ou a π2, respectivamente. E o menor valor para esta quantidade, obtido pela escolha adequada das regiões R1 e R2, é chamado de taxa ótima de erro (optimum error rate), OER,

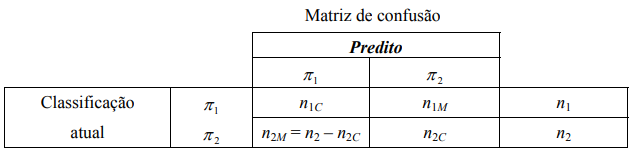

A taxa aparente de erro (que é definida como fração das observações no treinamento amostral) é calculada da matriz de confusão que mostra a situação real das observações nos grupos versus o reconhecimento. Para n1 observações de π 1 e n2 de π 2 , a matriz de confusão tem a forma:

Onde:

e é vista como a proporção de itens ou observações no conjunto de treinamento que são reconhecidos erroneamente.

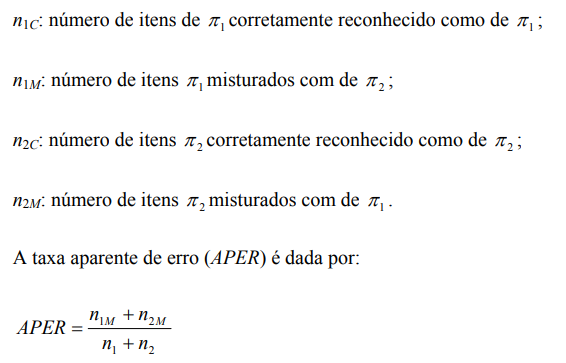

2. Abordagem de Lachenbruch:

É uma técnica para avaliar a eficiência da regra de classificação. Os passos são:

- Comece com o grupo da população π 1 . Omita uma observação deste grupo e construa uma função baseada nas n1 – 1 e n2 observações.

- Reconheça (classifique), usando a função, a observação não incorporada.

- Repita os passos 1 e 2 até que todas as n1 observações de π 1 sejam classificadas. Seja 1 H n M o número de observações reconhecidas erroneamente neste grupo.

- Repita os passos de 1 a 3 para as n2 observações de π 2 . Seja 2 H n M o número de observações reconhecidas erroneamente neste grupo.

Então,

4 ANÁLISE DE REGRESSÃO LINEAR:

A Análise de Regressão é a técnica estatística indicada quando se estuda o relacionamento entre as variáveis (dependente e independente). Existem numerosas aplicações desta técnica que ocorrem em quase todos os campos científicos. Na Engenharia de Avaliação, considera-se, geralmente, como variável dependente os preços à vista de mercado em oferta e efetivamente transacionados e como variáveis independentes as características do imóvel.

No modelo linear que pode representar os preços de mercado, a variável resposta (dependente) é expressa por uma combinação linear das variáveis independentes, de forma original ou transformada, e respectivas estimativas dos parâmetros populacionais, acrescidas de erro aleatório, oriundo de variações do comportamento humano.

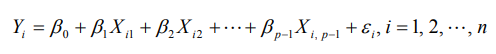

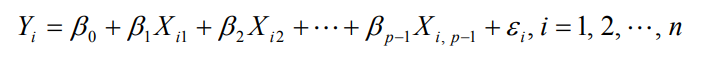

Assim, tem-se o modelo, que representa n observações,

Modelo Linear Geral de Regressão:

O modelo (2.70) com n observações pode ser colocado na forma matricial. Então se tem:

Y = Xβ + ε

onde Y é o vetor aleatório de resposta, β é o vetor de parâmetros de dimensão p, X é a matriz do modelo de ordem n x p e ε é o vetor aleatório de erros de dimensão n. E, de forma detalhada,

A aplicação completa do modelo é fundamentada nas seguintes suposições:

- o vetor de erros ε’ = [ε1, ε2,..., εn] é aleatório, ou seja, as componentes εi, i = 1, 2,..., n são variáveis aleatórias;

- a esperança de cada componente de ε é zero, ou seja, E(ε) = 0 e E(εi) = 0;

- as componentes do vetor ε não são correlacionadas, ou melhor, cov (εi, εj) = 0, i ≠ j e possuem variância constante, σ². Assim, a matriz de covariâncias de ε é a matriz diagonal σ²In, onde In é a matriz identidade de ordem n, V (ε) = σ² In.

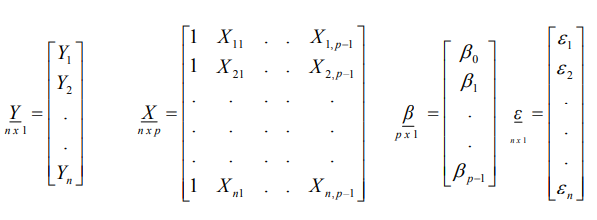

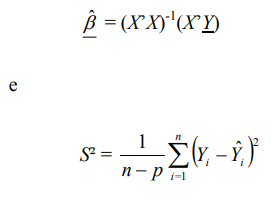

O modelo com as três suposições anteriores é conhecido como Modelo Linear de Gauss Markov e o Teorema de Gauss-Markov garante que sob as três suposições e com X’X não singular, os estimadores não viciados uniformemente de mínima variância (EUMV) do vetor β e da variância σ² são, respectivamente:

Uma outra suposição que pode ser exigida, além das já citadas, para o modelo de regressão é a seguinte:

- a distribuição de εi, i =1, 2,..., n é a Normal (Gaussiana).

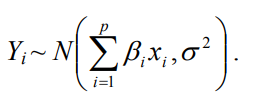

Levando em consideração esta suposição, tem-se o modelo de Gauss-Markov Normal e

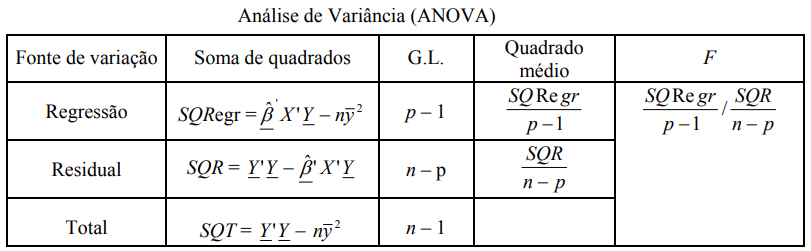

Análise da Variância da Regressão:

Esta análise é uma das técnicas estatísticas cujas bases foram lançadas por Fisher. É a técnica geralmente usada para verificar se o ajuste de regressão existe. É importante construir um quadro que resuma as informações da Análise da Variância (ANOVA), para o modelo geral:

com p ≥ 2 parâmetros.

O teste feito com a estatística F é o da hipótese nula H0: β1 = β2 = ... = βp-1 = 0, ou seja, se existe regressão dos X’s para Y, ou melhor, se existe relação linear entre a variável resposta Y e as covariáveis Xi, i = 1, 2,... , p – 1, este teste é fundamental para validade do modelo linear ajustado, ^ ^ Y = X β .

Verificação dos Pressupostos do Modelo:

a) Homocedasticidade:

A homocedasticidade corresponde à variância constante dos resíduos. É uma propriedade essencial e que deve ser garantida, sob pena de invalidar toda a análise estatística. Deseja-se que os erros sejam aleatórios, ou seja, não devem ser relacionados com as características dos imóveis. Quando a homocedasticidade não ocorre, há heterocedasticidade; significa dizer que as chances de ocorrerem erros grandes (ou pequenos) variam conforme o tipo de imóvel. Há tendências nos erros.

As consequências da heterocedasticidade são que as estimativas dos parâmetros da regressão (β0, β1, β2,..., βp-1) não são tendenciosas, mas são ineficientes e as estimativas das variâncias são tendenciosas. Os testes “t” e F tendem a dar resultados incorretos. Neste caso, os resultados não são confiáveis, ou seja, o modelo pode parecer bom, mas ele não é adequado aos dados, na verdade.

A homocedasticidade pode ser verificada através de gráficos de resíduos (erros). Se os pontos estão distribuídos aleatoriamente em uma faixa, sem demonstrar um comportamento definido, há homocedasticidade. No entanto, se existe alguma tendência (crescimento, decrescimento ou oscilação), então há heterocedasticidade. Havendo heterocedasticidade, podem ser feitas transformações nas variáveis (geralmente logarítmicas) ou outras soluções mais complexas. O modelo então, deve ser modificado.

b) Independência serial dos resíduos (não-autocorrelação):

Ocorre autocorrelação quando os erros são correlacionados com os valores anteriores ou posteriores na série. Este fenômeno é chamado de correlação serial. Seu surgimento pode se dar por especificação incorreta do modelo da regressão, por causa de erros na forma do modelo ou ainda, por exclusão de variáveis independentes importantes para a análise. Existindo autocorrelação, os estimadores ordinários de mínimos quadrados não são mais os melhores estimadores lineares não-tendenciosos.

Neste caso, existirão outros métodos que produzem menor variância amostral nos estimadores. Além disso, em presença de correlação serial, os testes de significância (t e F) e de construção de intervalos de confiança dos coeficientes da regressão também oferecem conclusões incorretas, isto é, as regiões de aceitação e os intervalos de confiança podem ser mais largos ou mais estreitos do que os calculados, dependendo da tendência ser positiva ou negativa. A verificação da autocorrelação pode ser realizada pela análise do gráfico dos resíduos comparados com os valores preditos, onde este deve apresentar pontos dispersos aleatoriamente, sem nenhum padrão definido ou pelo teste de Durbin-Watson.

c) Normalidade dos resíduos:

A Análise de Regressão baseia-se na hipótese de que os erros seguem uma distribuição Normal (distribuição de Gauss). Em presença de falta de Gaussianidade, os estimadores são não-tendenciosos, mas os testes não têm validade, principalmente em amostras pequenas. Entretanto, pequenas fugas da Gaussianidade não causam grandes problemas. A heterocedasticidade ou a escolha de um modelo incorreto para a equação pode ser a causa da não-normalidade dos resíduos.

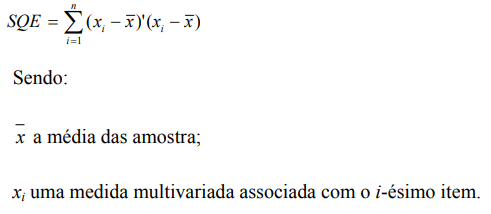

d) Outliers:

Denomina-se outlier um dado que contém grande resíduo em relação aos demais que compõem a amostra e assim tem comportamento muito diferente dos demais (Dantas). É de grande importância controlar os outliers, porque de acordo com a estimação da equação, um grande erro modifica significativamente seus somatórios, alterando os coeficientes da equação. Dessa forma, um imóvel apenas pode modificar a equação. Geralmente, adota-se o intervalo de 2 desvios padrões em torno da média dos erros, pois não existe um limite fixo. Como a média deve ser zero, os resíduos padronizados

devem estar entre –3 e 3. Os imóveis com erros que ultrapassam estes limites devem ser analisados cuidadosamente; a existência de outliers deve sempre ser interpretada como um sinal de problema na amostra.

e) Colinearidade ou multicolinearidade:

Multicolinearidade é definida como a existência de relações lineares entre as variáveis “independentes”, de tal forma correlacionada umas às outras, tornando-se difícil ou impossível isolarem suas influências separadas e obter uma estimativa precisa de seus efeitos relativos. Quando a relação é exata tem-se o caso da multicolinearidade perfeita. Raramente encontram-se variáveis independentes que são perfeitamente relacionadas.

Esse caso não traz problemas, pois é facilmente detectado e pode ser resolvido simplesmente eliminando uma ou mais variáveis independentes do modelo. O interesse no que se refere à multicolinearide está nos casos em que ela ocorre com alto grau, isto é, quando duas variáveis independentes estão significativamente correlacionadas ou quando há uma combinação linear entre um conjunto de variáveis independentes. Assim, a multicolinearidade é mais uma questão de grau do que de natureza (Kmenta).

O fato de muitas funções e regressões diferentes proporcionarem bons ajustes para um mesmo conjunto de dados é porque os coeficientes de regressão atendem várias amostras onde as variáveis independentes são altamente correlacionadas. “Assim, os coeficientes de regressão estimados variam de uma amostra para outra quando as variáveis independentes estão altamente correlacionadas.

Isso leva a informações imprecisas a respeito dos coeficientes verdadeiros” (Neter e Wasserman). Geralmente, a multicolinearidade é causada pela própria natureza dos dados, principalmente nas áreas de economia com variáveis que representam valores de mercado. Pode também ocorrer devido à amostragem inadequada.

Em Análise de Regressão Linear Múltipla, existe um freqüente interesse com relação à natureza e significância das relações entre as variáveis independentes e a variável dependente. “Em muitas aplicações de administração e economia, freqüentemente encontramse variáveis independentes que estão correlacionadas entre elas mesmas e, também, com outras variáveis que não estão incluídas no modelo, mas estão relacionadas à variável dependente” (Neter e Wasserman).

A existência de multicolinearidade tendo sido detectada e considerada prejudicial, indicando que o pesquisador deve procurar soluções para suavizar seus efeitos nocivos. Várias medidas corretivas têm sido propostas, desde medidas simples às mais complexas, para suavizar os efeitos provocados pela multicolinearidade (Elian; Judge). Algumas soluções para o problema da multicolinearidade são propostas, tais como: remoção de variáveis, ampliação do tamanho da amostra, adoção de técnicas estatísticas como Análise de Componentes Principais, entre outras. Neste trabalho aplicou-se a técnica das Componentes Principais para remover o problema da multicolinearidade entre as características dos imóveis.

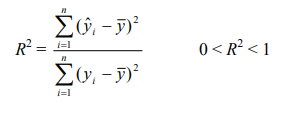

Poder de Explicação do Modelo:

Para se medir o quanto a variabilidade total dos dados é explicada pelo modelo de regressão, compara-se a Soma de Quadrados da Regressão com a Soma de Quadrados Total e, então, tem-se o coeficiente de determinação ou de correlação múltipla ao quadrado, R2,

Quando o ajuste é bom o modelo explica boa parte da variação total e, consequentemente, o valor de R2 é próximo de 1.

A estatística R2 indica a qualidade do ajuste do modelo adotado.

Relação entre Variáveis:

Na análise de um modelo de regressão o coeficiente de correlação é uma medida estatística muito importante. O grau de associação entre duas variáveis é definido numericamente pelo Coeficiente de Correlação, parâmetro representado por ρ. Com base em n observações do par (X, Y) este parâmetro é estimado pela estatística,

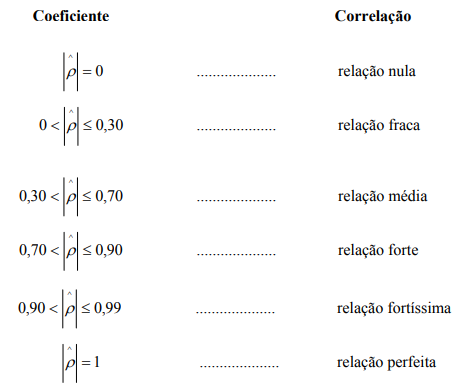

O coeficiente de correlação varia entre os limites –1 e 1 podendo ser positivo ou negativo (–1 ≤ ρ ≤ 1) e também nulo (ρ = 0). Quando ρ = 0 significa que não existe nenhum relacionamento entre as variáveis. Quando o coeficiente de correlação é igual à unidade, –1 ou + 1, tem-se um relacionamento perfeito entre elas. O grau de relacionamento entre as variáveis, definido numericamente pelo valor ^ ρ no caso amostral, pode ser assim interpretado:

Nota-se também que nem sempre uma elevada correlação entre duas variáveis representa a existência de relação de causa e efeito entre as mesmas. Esses casos dão origem às chamadas de influência no caso. O estudo do relacionamento entre um conjunto de variáveis pode ser realizado aplicando diversas técnicas, desde os coeficientes de correlação de Pearson, de Spearman, Análise Fatorial e a Análise de Componentes Principais. A estatística (2.76) é conhecida como o coeficiente de correlação linear de Pearson e é uma medida usada no estudo da relação linear existente entre duas varáveis X e Y.

Seleção de Variáveis Regressoras:

Um dos problemas mais frequentes em Análise de Regressão é a seleção do conjunto de variáveis independentes a serem incluídas no modelo (Neter e Wasserman).

O pesquisador deve especificar o conjunto de variáveis independentes a ser empregado para descrever, controlar ou predizer a variável dependente. Um problema muito difícil de relacionamento que aparece na seleção de variáveis é quando uma equação de regressão é construída com o objetivo de predição e envolve muitas variáveis. Talvez, muitas delas contribuam pouco ou nada para a precisão da predição. A escolha apropriada de algumas delas fornece a melhor predição, porém quais e quantas devem ser selecionadas? (Snedecor e Cochram).

Em algumas áreas, a teoria pode ajudar na seleção das variáveis independentes a serem empregadas e na especificação da forma funcional da relação de regressão. Os experimentos podem ser controlados para fornecer dados sobre a base de que os parâmetros de regressão podem ser estimados e a forma teórica da regressão testada. Em muitos outros campos, modelos teóricos são raros. Assim, os investigadores são frequentemente forçados a explorar as variáveis independentes para que possam realizar estudos sobre a variável dependente.

Algumas das variáveis independentes podem ser removidas seletivamente. Uma variável independente pode não ser fundamental ao problema; pode estar sujeita a grandes erros de medidas e pode duplicar outra variável independente da lista. Assim, outras variáveis independentes, que não podem ser medidas, podem então ser excluídas ou substituídas por variáveis que estão altamente correlacionadas com estas.

Normalmente, após uma seleção inicial, o número de variáveis independentes ainda é grande. Sendo assim, o investigador geralmente desejará reduzir o número de variáveis independentes a serem usadas no modelo final, existindo razões para isto: uma delas é que um modelo de regressão com um número grande de variáveis independentes é caro para se utilizar. O problema torna-se, então, de como reduzir a lista de variáveis independentes de forma a obter a melhor seleção de variáveis independentes.

Este conjunto precisa ser pequeno para que a manutenção dos custos de atualização do modelo seja manuseável e a análise facilitada, e ainda, deve ser grande o suficiente de forma que seja possível uma descrição, um controle e uma predição adequados. Existem muitos procedimentos de seleção, mas nenhum deles pode, comprovadamente, produzir o melhor conjunto de variáveis independentes. Dentre os procedimentos, pode-se citar como os mais comumente usados: todas as regressões possíveis, backward, forward e stepwise.

Todas as regressões possíveis: consiste em ajustar todas as possíveis equações de regressão. Após a obtenção de todas as regressões, devem-se utilizar os critérios para comparação dos modelos ajustados. Alguns critérios que podem ser usados são o 2 R (coeficiente de explicação), MSE (quadrado médio dos resíduos) e Cp (estatística de Mallows). Para alguns conjuntos de variáveis, os três critérios podem levar para o mesmo “melhor” conjunto de variáveis independentes.

Este não é o caso geral, pois diferentes critérios podem sugerir diferentes conjuntos de variáveis independentes. Daniel e Wood recomendam, no caso de um grande número de equações alternativas, o critério do erro quadrado total para caracterizar a equação. A principal desvantagem do procedimento de procura de todas as regressões possíveis é a quantidade de esforço computacional necessária, já que cada variável independente potencial pode ser incluída ou excluída, gerando regressões possíveis quando existem p variáveis independentes potenciais (Elian; Draper e Smith).

Stepwise (passo a passo): É o método mais usado dos métodos de pesquisa que não requerem a computação de todas as regressões possíveis. A rotina de regressão stepwise permite que uma variável independente, trazida para dentro do modelo em um estágio anterior, seja removida subsequentemente se ela não ajudar na conjunção com variáveis adicionadas nos últimos estágios. Esta rotina empregada conduz a um teste para rastrear alguma variável independente que seja altamente correlacionada com variáveis independentes já incluídas no modelo.

A limitação da procura da regressão stepwise é que ela presume a existência de um único conjunto ótimo de variáveis independentes e busca identificá-lo. Como notado anteriormente, não existe freqüentemente um único conjunto ótimo. Outra limitação da rotina de regressão stepwise, é que ela algumas vezes surge com um conjunto de variáveis independentes razoavelmente fracos para predições, quando as variáveis independentes estão altamente correlacionadas (Draper e Smith).

Seleção forward: É uma versão simplificada da regressão stepwise, omitindo o teste, se uma variável uma vez que tenha entrado no modelo deva ser retirada. Este procedimento considera, inicialmente, um modelo simples usando a variável de maior coeficiente de correlação com a variável dependente. Uma variável por vez é incorporada até que não haja mais inclusão, e as variáveis selecionadas definem o modelo.

Eliminação backward: Este procedimento de procura é oposto à seleção forward. Ele começa com o modelo contendo todas as variáveis independentes potenciais. O procedimento backward requer mais cálculos do que o método de seleção forward, já que ele começa com o maior modelo possível. Entretanto, ele tem uma vantagem de mostrar ao analista as implicações do modelo com muitas variáveis.

5 NBR 14653-1 – Avaliação de Bens – Procedimentos Gerais

1. Introdução

A norma NBR 14653-1, elaborada pela Associação Brasileira de Normas Técnicas (ABNT), estabelece os procedimentos gerais para a avaliação de bens. Ela constitui a parte fundamental da série NBR 14653, servindo como referência para as demais partes específicas que tratam de imóveis urbanos, rurais, máquinas, equipamentos, empreendimentos e outros ativos.

Seu principal objetivo é uniformizar critérios técnicos, garantindo transparência, coerência e confiabilidade nos trabalhos de avaliação realizados por profissionais habilitados.

2. Conceitos Fundamentais

De acordo com a norma, avaliação de bens é o conjunto de procedimentos técnicos destinados a determinar o valor de um bem, de seus direitos ou frutos, em uma data determinada, para uma finalidade específica.

Entre os conceitos-chave previstos estão:

Valor de mercado: estimativa mais provável de preço em uma negociação em condições normais de mercado.

Valor de liquidação: preço provável em condições de venda forçada ou prazo reduzido.

Data de referência: momento em que o valor é válido, devendo sempre ser explicitado no laudo.

Finalidade da avaliação: motivo pelo qual o trabalho é realizado, podendo envolver compra e venda, garantias, inventários, desapropriações, partilhas, etc.

3. Etapas do Processo Avaliatório

A NBR 14653-1 define as seguintes etapas básicas do processo de avaliação:

Planejamento: definição dos objetivos, finalidade, tipo de bem e metodologia a ser aplicada.

Coleta de dados: levantamento de informações de mercado, características do bem e fatores influenciadores do valor.

Tratamento e análise: aplicação de métodos técnicos, como comparativo direto de dados de mercado, involutivo, evolutivo, renda ou custo.

Conclusão e laudo: consolidação dos resultados em documento técnico formal, com linguagem clara e justificativas fundamentadas.

4. Princípios e Responsabilidades Técnicas

A norma enfatiza princípios que devem nortear o avaliador:

Imparcialidade e independência profissional;

Uso de métodos reconhecidos e compatíveis com o objeto e finalidade da avaliação;

Apresentação transparente dos critérios, dados e resultados;

Assinatura de responsabilidade técnica por profissional habilitado conforme legislação vigente (geralmente engenheiro, arquiteto ou tecnólogo registrado no CREA/CAU).

Além disso, o avaliador deve manter registro documental dos dados utilizados e estar preparado para prestar esclarecimentos sobre o processo técnico empregado.

5. Estrutura do Laudo de Avaliação

O laudo de avaliação, segundo a NBR 14653-1, deve conter:

Identificação do solicitante e do avaliador;

Finalidade da avaliação e data de referência;

Descrição detalhada do bem e dos direitos avaliados;

Fundamentação teórica e metodologia adotada;

Dados, cálculos e justificativas;

Conclusão expressando o valor determinado e o grau de precisão;

Anexos e documentos comprobatórios.

A norma também recomenda a indicação do grau de fundamentação e precisão da avaliação, que variam conforme a quantidade e qualidade dos dados disponíveis e a complexidade do bem.

6. Importância da Norma para o Mercado Imobiliário

No contexto da avaliação de imóveis urbanos, a NBR 14653-1 é a base que garante a padronização e credibilidade das avaliações utilizadas por bancos, seguradoras, órgãos públicos e particulares.

Ela assegura que os laudos sejam comparáveis, rastreáveis e tecnicamente justificáveis, reduzindo conflitos e fortalecendo a confiança nos resultados apresentados.

7. Conclusão

A NBR 14653-1 é um marco na profissionalização das avaliações de bens no Brasil. Ela estabelece um referencial ético e metodológico, exigindo do avaliador conhecimento técnico, rigor documental e clareza na comunicação dos resultados.

O domínio dessa norma é indispensável para todos os profissionais que atuam no mercado imobiliário, pois dela derivam os fundamentos para as avaliações de imóveis urbanos, rurais e demais categorias previstas na série NBR 14653.

6 NBR 14653-2 – Avaliação de Bens – Imóveis Urbanos

1. Introdução

A NBR 14653-2, publicada pela Associação Brasileira de Normas Técnicas (ABNT), complementa a NBR 14653-1 ao tratar especificamente dos procedimentos aplicáveis à avaliação de imóveis urbanos.

Seu propósito é definir os critérios, métodos e parâmetros técnicos que devem ser seguidos por engenheiros, arquitetos e demais profissionais habilitados, assegurando uniformidade, precisão e confiabilidade nos valores atribuídos a bens imobiliários localizados em áreas urbanas.

2. Objetivo e Abrangência

A norma estabelece diretrizes para a avaliação de terrenos, edificações, benfeitorias e direitos a eles vinculados, em zonas urbanas e de expansão urbana.

Ela aplica-se a avaliações realizadas para:

Compra e venda;

Garantias de crédito (hipotecas, financiamentos, alienações fiduciárias);

Inventários e partilhas;

Desapropriações e indenizações;

Revisões de valores locatícios;

Planejamento urbano e regularizações patrimoniais.

3. Tipos de Valores Utilizados

A NBR 14653-2 define diferentes tipos de valores que podem ser determinados conforme o objetivo do trabalho:

Valor de mercado: preço mais provável em condições normais de comercialização;

Valor de custo de reprodução ou substituição: referente ao custo de reconstrução do bem, deduzidas as depreciações;

Valor de liquidação: valor provável em condições de venda forçada;

Valor locativo: valor estimado de aluguel ou renda;

Valor residual: diferença entre o valor total do empreendimento e o custo da construção.

Cada tipo de valor exige tratamentos e métodos específicos, que devem ser claramente justificados no laudo.

4. Métodos de Avaliação

A norma reconhece cinco métodos principais, cabendo ao avaliador escolher o mais adequado conforme o tipo de imóvel e a finalidade da avaliação:

Método Comparativo Direto de Dados de Mercado:

Baseia-se na comparação entre o imóvel avaliado e outros similares negociados recentemente. É o método preferencial, por refletir o comportamento real do mercado.Método Involutivo:

Utilizado em terrenos passíveis de parcelamento ou incorporação. Calcula o valor a partir do resultado econômico de um empreendimento hipotético, descontando custos e margem de lucro.Método Evolutivo:

Determina o valor do imóvel pela soma do valor do terreno (obtido geralmente por comparação) e o valor das benfeitorias (calculado pelo custo de reprodução, deduzindo depreciações).Método da Renda:

Aplica-se a imóveis que geram renda (como edifícios comerciais, hotéis, shoppings). O valor é calculado com base na capitalização da renda líquida prevista.Método do Custo:

Considera o custo necessário para construir ou substituir o bem, ajustado pelas depreciações físicas, funcionais e econômicas.

5. Fatores que Influenciam o Valor

A NBR 14653-2 identifica fatores que devem ser cuidadosamente analisados, pois influenciam diretamente o resultado da avaliação:

Localização e acessibilidade;

Padrão construtivo e estado de conservação;

Infraestrutura urbana disponível;

Uso e ocupação do solo conforme o plano diretor;

Oferta e demanda imobiliária;

Situação jurídica e documental do imóvel.

O avaliador deve documentar todos esses aspectos, demonstrando como cada um foi ponderado na análise final.

6. Tratamento Estatístico dos Dados

O tratamento estatístico é parte essencial da norma.

Quando aplicado o método comparativo direto, a norma exige:

Seleção criteriosa dos dados amostrais;

Verificação de consistência e homogeneidade;

Utilização de técnicas estatísticas como regressão linear, análise de variância e cálculo de intervalos de confiança;

Identificação e exclusão de valores atípicos (outliers).

Esses procedimentos garantem maior precisão e transparência, permitindo justificar numericamente o valor obtido.

7. Estrutura do Laudo de Avaliação

O laudo técnico de avaliação de imóveis urbanos, conforme a NBR 14653-2, deve conter:

Identificação completa do imóvel, com localização, área e características físicas;

Descrição do entorno urbano e infraestrutura;

Finalidade da avaliação e data de referência;

Metodologia adotada, com justificativas técnicas;

Tratamento e análise dos dados de mercado;

Conclusão com o valor final e grau de precisão;

Documentos complementares (plantas, fotos, mapas, certidões e cálculos).

A redação deve ser clara, objetiva e baseada em critérios verificáveis.

8. Grau de Fundamentação e Precisão

A norma determina que o avaliador indique o grau de fundamentação (I, II, III, IV) e o grau de precisão (A, B, C) do trabalho.

Esses parâmetros variam conforme:

Quantidade e qualidade dos dados disponíveis;

Nível de homogeneidade dos elementos comparativos;

Profundidade das análises e modelos utilizados.

Quanto mais consistente for o estudo de mercado, maior será o grau de precisão atribuído ao laudo.

9. Importância Profissional e Legal

O cumprimento da NBR 14653-2 é essencial para garantir:

Reconhecimento técnico e jurídico dos laudos em instituições financeiras e órgãos públicos;

Confiabilidade nos processos de crédito, compra, venda e desapropriação;

Segurança nas operações imobiliárias e patrimoniais.

Profissionais que desconsideram os critérios da norma correm risco de invalidar seus laudos e responder eticamente junto ao CREA ou CAU.

10. Conclusão

A NBR 14653-2 é o principal instrumento técnico que orienta as avaliações de imóveis urbanos no Brasil.

Ela fornece métodos padronizados, critérios objetivos e responsabilidades claras, fortalecendo a credibilidade da profissão e garantindo justiça e transparência nas relações imobiliárias.